现代 AI 图像生成器正在迅速进化,早期那种一眼可见的破绽——比如畸形的手脚、乱七八糟的文字、怪异的画面噪点——正逐渐被工程手段抹平。 如今,很多合成图片已经足以骗过普通人的肉眼,在社交媒体上不加控制地传播。 然而,发表在《科学》(Science)期刊上的一项研究指出,这些模型在本质上依然“不了解”现实世界中光线和几何的运行方式,物理规律正在成为识别真伪图像最可靠的工具之一。

研究者指出,只要测量反射、阴影、透视线等看似细枝末节的部分,就仍然有机会拆穿一张看似完美的 AI 照片。 这种基于物理世界一致性的核查方法,被数字取证专家视为在“深度伪造”时代区分真实照片与 AI 伪造的重要防线。 早期的鉴别往往依赖肉眼捕捉粗糙的技术瑕疵,但随着生成质量提升,图像开始越来越符合人类对“真实”的主观期待——色彩鲜明、构图戏剧化、充满电影感,这种“被制造出的戏剧性”反而让人更容易放松警惕。

加州大学伯克利分校教授、被广泛视为数字取证领域奠基人之一的 Hany Farid,一直在利用 AI 图像的另一种“隐性弱点”。 他的方法不是去寻找明显的视觉错误,而是把生成图跟现实世界中应当出现的几何关系进行逐一对照。 在他看来,现有的图像生成模型尚未真正学会美术课上的基础概念——消失点。

以一张 AI 生成的“士兵在长廊中行进”的图片为例,图中可以看到一些显而易见的缺陷,比如墙上模糊难辨的文字、莫名其妙的链条等。 但更关键的线索藏在地面的瓷砖里:按照透视原理,现实中的平行线(例如地砖缝、木地板接缝)在画面中应当延伸并汇聚到同一个消失点。 如果用直线工具沿着这些结构画线,就可以检查它们是否像真实照片那样在远方交汇,从而初步判断图像是否可信。

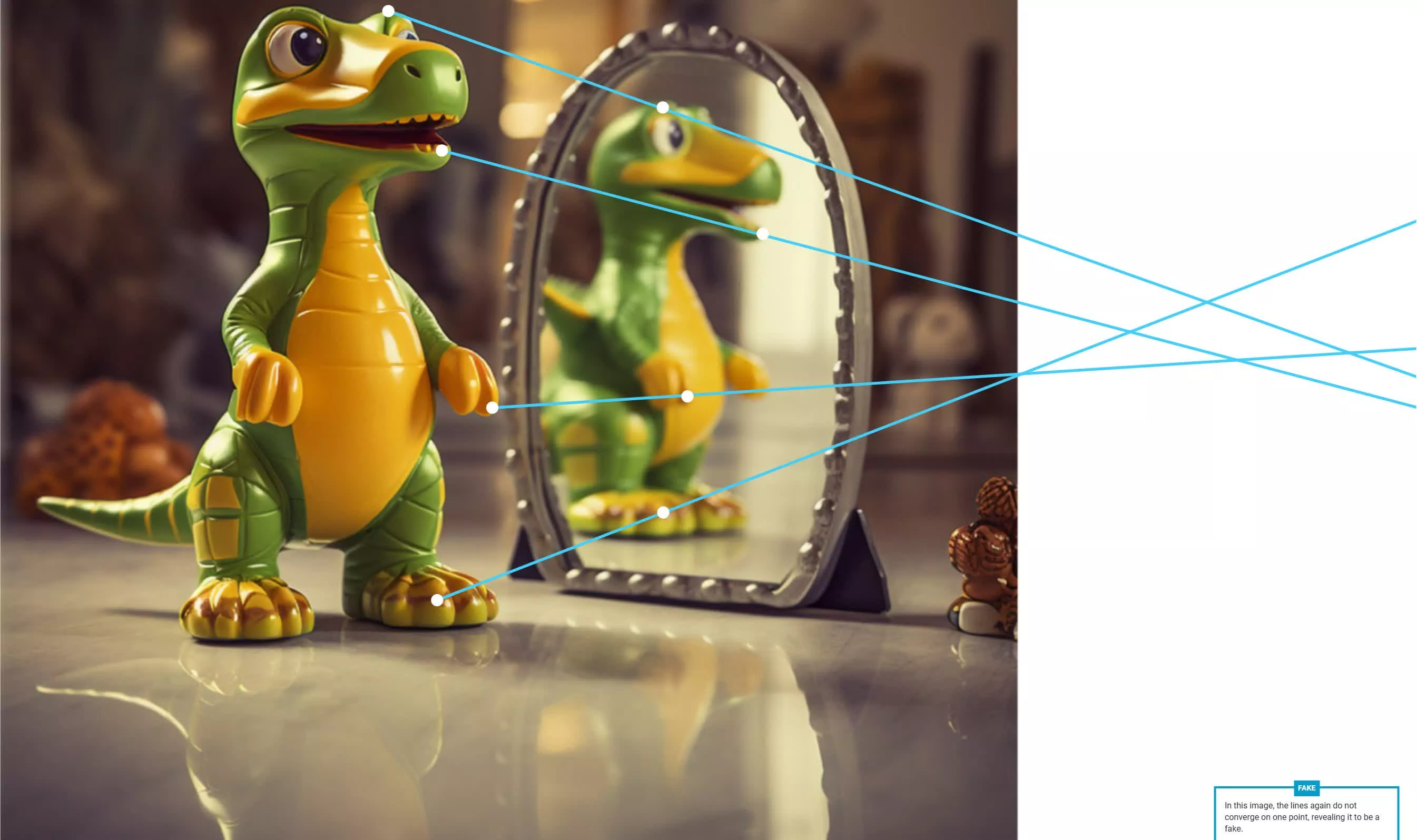

类似的几何关系同样适用于反射。 研究指出,尽管今天的生成模型已经能合成足以蒙混人眼的水面或镜面反射,只要拿直尺量一量,问题就会暴露出来。 在真实世界中,物体某一点与其在反射中的对应点之间连线,应当彼此平行,并在延长后指向一致的消失点;一旦这些线条出现不该有的偏差,就很可能意味着这是一张合成图。

阳光投下的阴影也为这种测试提供了额外抓手。 由于太阳距离地球极其遥远,可以近似认为照射到地面的阳光是平行光线。 在这种前提下,物体某个点与其阴影中对应点之间的连线,同样应该能够延长并汇聚于一个消失点。 如果一张照片中,不同物体的阴影线无法指向一致的几何关系,则很可能违背了光学基本规律。

目前还很难预测生成式模型何时、以及能否在根本上克服这些物理层面的错误。 相比早期那些肉眼易辨的瑕疵,基于透视和光线的“几何验真”要求观察者花费更多时间和精力,远超一般社交媒体用户的日常警惕阈值。 一些研究者甚至认为,对这种物理规则的深刻掌握,可能已经超出当前主流生成模型的设计能力范围。

在这项工作之外,专家也提醒用户对“用 AI 识别 AI”的做法保持谨慎。 一些自动检测工具在特定条件下确实可能比未受训练的人眼更可靠,但一旦输入图像和其训练数据分布差异过大,算法就会出现失误甚至系统性偏差。 换言之,把甄别任务完全交给另外一个黑盒模型,并不是万无一失的解决方案。

一篇相关研究还提出了一个耐人寻味的发现:确认一张照片“是真的”,可能比识别一张“假的”更难。 这项研究指出,观者审视图像的时间越长而始终找不到破绽,那么它是真实照片的概率就越高。 从这个角度看,“没有发现错误”本身,反而可以成为真实性的证据之一。