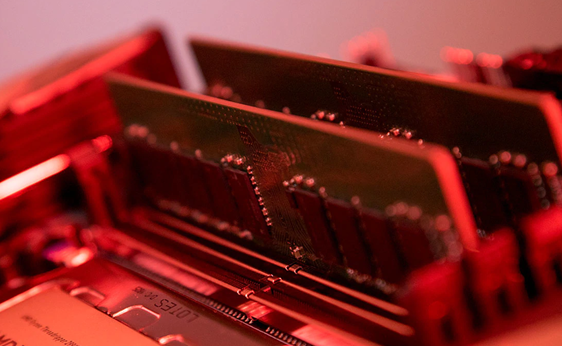

据媒体报道,被业界誉为“HBM(高带宽内存)之父”的韩国学者金正浩指出,AI计算的主导权正加速从GPU向内存转移。随着人工智能从生成式迈向智能体(Agentic AI)时代,内存正成为制约发展的关键瓶颈。金正浩认为,这一转变的核心在于“上下文工程”的兴起,AI需要同时处理海量文档、视频及多模态数据。

为支撑这一趋势,内存带宽与容量需实现最高达1000倍的提升,才能保障系统运行的速度与准确性。当输入规模扩大100至1000倍时,内存需求可能呈指数级增长,最高甚至达到百万倍。

在此背景下,金正浩指出,当前通过堆叠DRAM实现超高带宽的HBM产品,或难以满足智能体时代的需求。他重点看好HBF(High Bandwidth Flash,高带宽闪存)技术。

作为一种新型存储方案,HBF通过堆叠NAND闪存替代DRAM,构建类似“巨型书架”的长期存储体系,在容量上实现数量级跃升。

金正浩进一步表示,AI产业的权力格局或将因此发生转移,由GPU向内存倾斜。尽管现阶段计算架构仍以GPU和CPU为核心,但未来的系统将围绕超大容量内存(如HBM与HBF)构建,处理器则更像是嵌入其中的组件。

这一构想已在产业界初现端倪。今年2月,SK海力士在提交至电气与电子工程师学会(IEEE)的论文中提出了“H3架构”,混合配置HBM与HBF。

论文指出,HBF相比HBM带宽相当、容量更大,但访问延迟更长、写入耐久性更差、功耗更高。因此,H3将HBF作为HBM的“二级扩展”,HBF负责存储只读数据,HBM负责其余数据。

金正浩预计,HBF工程样品有望在2027年前后面世,谷歌、英伟达或AMD等厂商最快可能在2028年开始采用该技术。围绕HBF的竞争或将重演HBM时代的格局,三星电子与SK海力士有望再度正面交锋。