据《华尔街日报》报道,AI领域正在经历一场重大变革,这对大大小小的科技公司都影响深远。过去五年间,AI领域的主要焦点一直是大语言模型的训练。这是一个成本高昂的过程,需要数万块芯片、消耗巨大的能源,且在偏远的大型数据中心进行。这一训练过程需要使用数千个专业微处理器芯片组成的集群,将数十亿条信息(如词语定义、历史事实、财务统计数据、猫咪照片等)输入模型。芯片集群每周7天、每天24小时运行,持续数周甚至数月之久。

图1:黄仁勋开始发力推理芯片

从训练到推理

如今,随着越来越多的公司部署AI智能体,并试图将基于大语言模型构建的新工具商业化,焦点已转向推理:这种计算方式能让训练好的AI模型响应用户的查询。

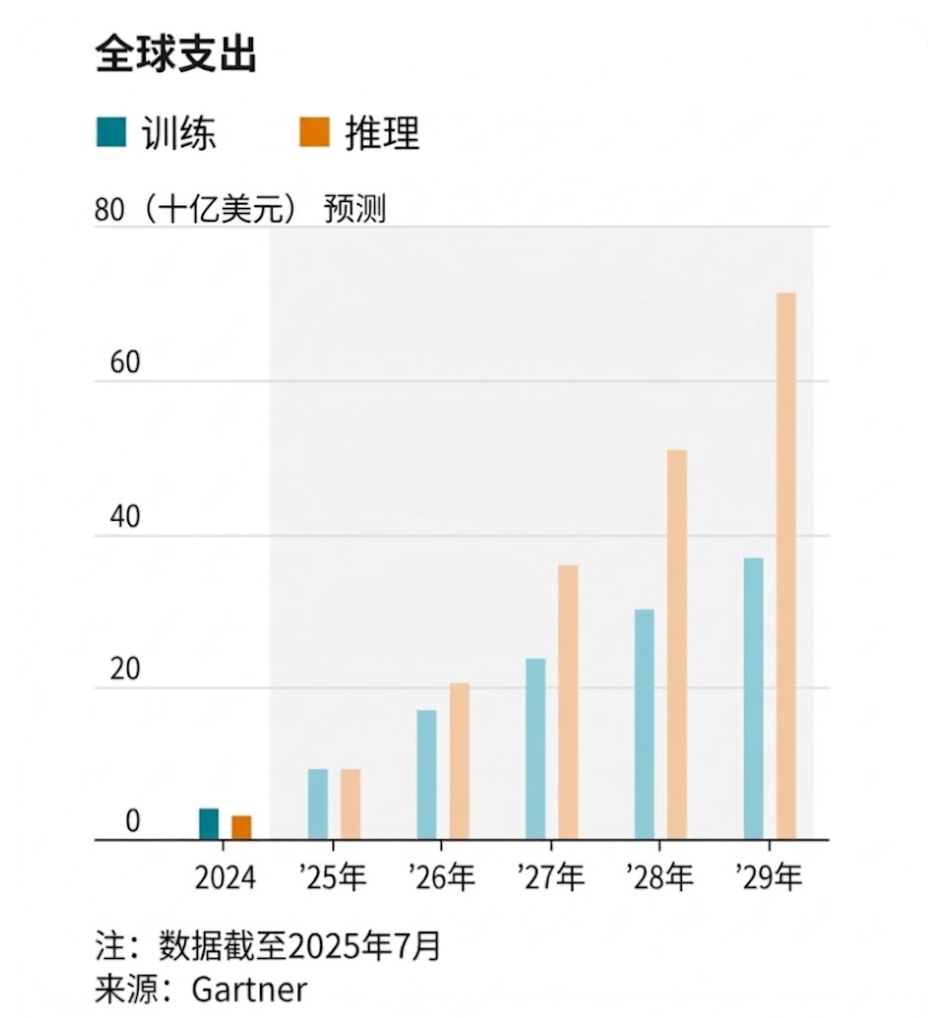

根据研究机构Gartner的数据,今年全球在推理基础设施(包括芯片、数据中心和网络硬件)上的资本支出,预计将首次超过训练资本支出。到2029年,企业在推理上的投入将达到720亿美元,是训练投入370亿美元的近两倍。

推理支出将超过训练

这一转变意味着,科技公司购买的芯片类型将发生重大变化。英伟达之所以成为全球市值最高的公司,靠的是销售名为GPU的芯片,这类芯片具备模型训练所需的原始处理能力。但乔治城大学研究AI的学者雅各布·菲尔德戈伊斯(Jacob Feldgoise)表示,那些预期将进行更多推理工作的公司,可以通过使用专门为推理任务优化的芯片来获得性能提升。

专门生产推理芯片的制造商包括谷歌、Cerebras Systems、SambaNova等,他们正以越来越快的速度签下价值数十亿美元的订单。英伟达则准备推出自己的推理专用处理器,此前该公司于去年12月斥资200亿美元,获得了定制推理芯片公司Groq的技术授权并吸纳其顶尖人才。

那么,究竟什么是推理计算?它与训练所需的计算有何不同?为什么需求如此迅速转向推理?这对市场又意味着什么?

推理计算的原理

你可以把AI想象成一家餐厅。模型就是那位厨师。在经过一段时间的密集培训,学习了数百乃至数十亿个食谱和烹饪技巧后,它就可以开始接单了。

推理就是这家餐厅的日常运营。食客下单(通常以向聊天机器人提问的形式),厨师备餐(聊天机器人生成回应)。

推理的原理

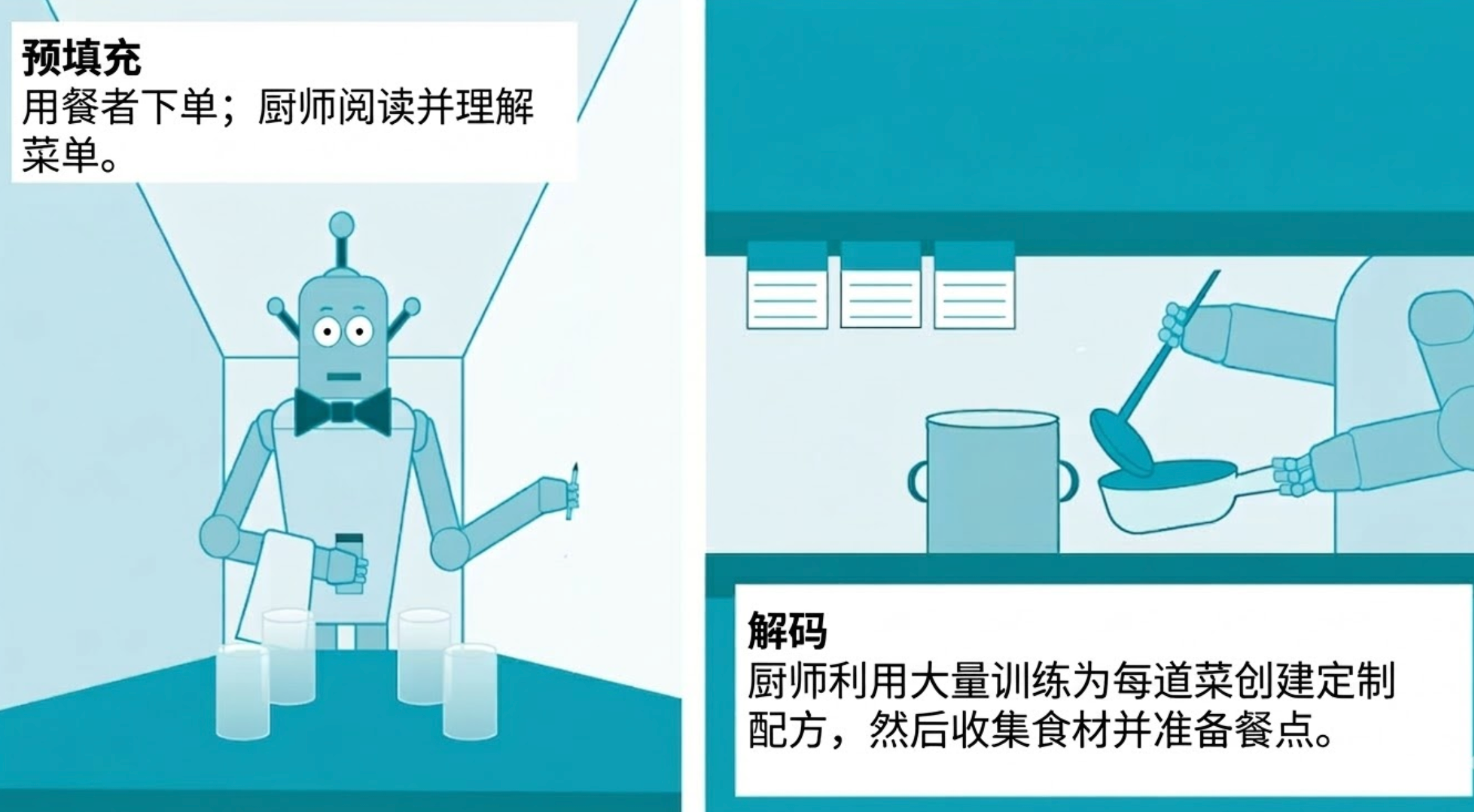

推理包含两个阶段,即预填充和解码。当用户输入提示词时,预填充阶段开始,模型通过处理其中的每个单词、符号或图像来解读用户的查询。

解码则是模型运用其在训练中学到的一切,生成查询响应的过程。

推理的这两个阶段对芯片有着不同的要求:预填充阶段需要更强的处理能力,而解码阶段则需要更大的内存,部分原因在于它必须调动所积累的全部知识,才能为用户呈上新鲜出炉的“词元”(token)。

什么是词元?

词元是用于处理查询并生成响应的基本数据单位。

虽然不同类型的数据对应的换算范围有所不同,但通常认为一个词元大约相当于四分之三个英文单词。以“今天天气怎么样?”这样简单的聊天机器人查询为例,模型会将其解析为六到八个词元。

词元

模型通常逐次生成一个词元,并且必须按正确的顺序输出每个词元,这样才能保证回答通顺合理。

目前,那些正试图将AI工具变现的公司,从会计软件、旅行预订服务到图像生成器,都痴迷于诸如“每瓦每秒生成的词元数”或“每美元每秒生成的词元数”这类成本指标。

芯片制造商格芯的CEO蒂姆·布林(Tim Breen)表示,这使得推理芯片高效输出结果的能力变得尤为重要,“如今,降低推理成本才是关键所在”。

训练与推理芯片的区别

由于训练需要在长时间内处理海量数据,所采用的芯片必须具备强大的处理能力,且芯片所在的数据中心必须能够获得充足的能源以及用于冷却芯片的水。训练同样需要内存,但如果GPU内存不足,可以将部分处理任务分派给其他芯片,或者等待现有内存释放。

相比之下,推理过程是按需进行的,耗时以秒计,而非数周。“超过十秒钟,用户就已经开始用大拇指敲手机屏幕,准备去做下一件事了。”芯片设计公司SambaNova的CEO罗德里戈·梁(Rodrigo Liang)表示。

因此,推理芯片必须配备更大容量的高带宽内存,且其所在的数据中心必须邻近用户聚集区以降低延迟。像Ayar Labs这样的芯片创业公司也越来越多地采用光纤连接组件,光纤的数据传输速度比铜缆更快,且所需冷却更少。

Ayar Labs CEO马克·韦德(Mark Wade)表示:“如今,一切都围绕着推理规模化展开。”