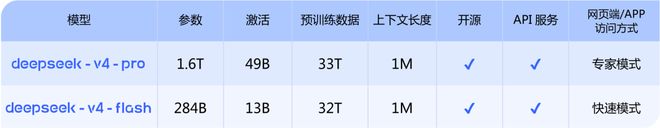

万众期待中,DeepSeek V4,终于发布了!就在刚刚,被期待已久的 DeepSeek V4 预览版正式登场。两个版本——V4-Pro 和 V4-Flash,全系标配 1M(百万字)超长上下文,同步开源模型权重和技术报告。

五一前的这两天,大模型又进入新一轮发布潮。

4 月 23 日中午,「天才少年」姚顺雨交出加入腾讯后的第一份模型答卷,腾讯混元 Hy3 预览版亮相,2950 亿参数的 MoE 架构,激活参数 21B,推理效率提升 40%,输入价格压到 1.2 元/百万 tokens。

今天凌晨,OpenAI 面向付费用户上线 GPT-5.5 并官宣 API 计划,主打 Agent 工作流和多步骤任务完成,上下文窗口拉到 100 万 tokens,API 定价也水涨船高——输入 5 美元、输出 30 美元/百万 tokens。

表面上,三家路径各不相同:OpenAI 走高端闭源路线,继续抬高价格天花板;腾讯把模型塞进自家生态,用性价比撬动规模化商用;DeepSeek 则延续开源传统,同时把上下文长度推到一个新的普惠临界点。

同时,Agent 能力、超长上下文、代码与工具调用,这三个关键词,在三家发布的新模型里反复出现。他们都在同一个方向上加注:让模型能处理更长的信息,能在更复杂的任务链条里自主运作,能真正嵌入到工作流程中去「干活」。

01

DeepSeek V4 的「实用主义」

DeepSeek 这次发布,把百万字上下文从「高端选配」变成了「基础标配」。

在此之前,1M 级别的上下文长度,更多出现在旗舰闭源模型的高端版本里,高昂的调用成本足,以让大多数开发者和中小企业望而却步。

而 DeepSeek 的做法十分明确:V4-Pro 和 V4-Flash 两个版本全系标配 1M 上下文长度,前者锚定极致性能,后者提供普惠经济之选,完整覆盖不同需求层级的用户。这种「无差别下放核心能力」的策略,本质上是在彻底降低长文本处理能力的行业获取门槛。

图片来源:DeepSeek 官网

Flash 版本主打极致低延迟与高性价比,是 DeepSeek 面向轻量化高频场景给出的核心方案。凭借 13B 的激活参数、全新的 token 压缩注意力机制与 DSA 稀疏注意力架构优化,它在保障接近 Pro 版核心推理能力的同时,实现了极快的响应速度,对于实时对话交互、函数调用流水线,乃至所有对响应速度敏感的轻量化场景而言,这一特性能带来体验上的本质提升。

更关键的是具有竞争力的成本结构。

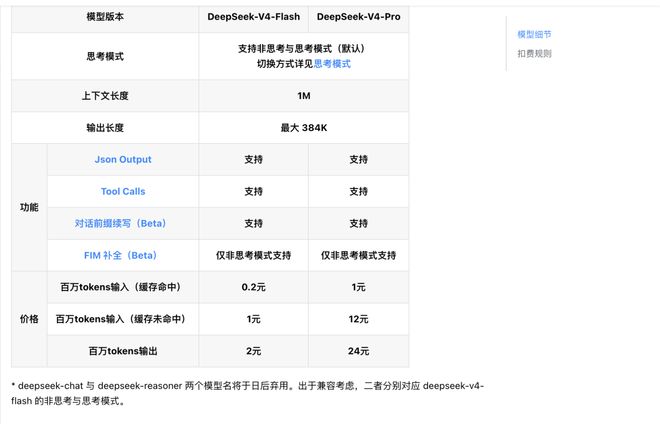

根据 DeepSeek 官方 API 定价文档,Flash 版本采用阶梯式计费规则:缓存命中的输入 token 低至 0.2 元 / 百万 tokens,缓存未命中的输入 token 为 1 元 / 百万 tokens,输出 token 定价为 2 元 / 百万 tokens。

DeepSeek V4 各个版本成为|图片来源:DeepSeek API 文档

如此亲民的定价,叠加全系标配的 1M 上下文能力,使得「单次调用成本」不再是工程设计中的核心约束——开发者可以优先考虑产品体验与架构设计,而无需反复在调用次数与费用之间做权衡。

Flash 解决的是「用得起、用得快」的普惠需求,V4-Pro 则在回答另一个核心问题:开源大模型的能力边界,究竟还能被推到哪里。

最直观的能力跃升,依然围绕长上下文展开。DeepSeek 将模型上下文长度从上一代 V3.2 的 128K,直接拉升至 1M(一百万 token),配合底层架构的创新,在大幅降低长上下文计算与显存需求的同时,保障了全上下文窗口的性能无损。

在这一规模下,开发者可以直接导入完整代码库、超长行业文档、多轮项目档案甚至百万字级别的完整书籍进行端到端处理,无需额外搭建复杂的检索增强生成(RAG)系统,大幅简化了长文本处理的技术链路。

在底层架构上,Pro 版本采用了总参数 1.6T、激活参数 49B 的 MoE 架构,预训练数据量达 33T,是对 DeepSeek 混合专家路线的全面深化。官方评测数据显示,其在数学、STEM、竞赛级代码等核心推理测评中,超越了当前所有已公开评测的开源模型,达到了比肩世界顶级闭源模型的水平。

在 Agent 能力上,其交付质量已接近 Claude Opus 4.6 非思考模式,内部使用反馈优于 Anthropic Sonnet 4.5,成为了 DeepSeek 内部员工的主力 Agentic Coding 工具。

功能层面,V4 全系列两个版本均同时支持非思考模式与思考模式,开发者可通过 reasoning_effort 参数自定义思考强度,同时全量支持 Json Output、Tool Calls、对话前缀续写能力。

定价方面,Pro 版本同样延续了高性价比路线,官方定价为:缓存命中的输入 token1 元 / 百万 tokens,缓存未命中的输入 token12 元 / 百万 tokens,输出 token 定价 24 元 / 百万 tokens,显著低于海外同级别旗舰闭源模型。

API 接入也做到了极致低门槛,开发者无需修改原有 base_url,仅需将 model 参数替换为对应版本名称,即可完成接入,同时兼容 OpenAI ChatCompletions 与 Anthropic 两种接口格式。

这种「能力上探 + 成本下探」的组合拳,让顶级的大模型能力不再是少数厂商的专属资源。当行业内卷逐渐陷入参数军备竞赛的怪圈,DeepSeek 用全系标配百万上下文、全链路开源开放的选择,给大模型的普惠化,给出了一个全新的范本。

同时,DeepSeek V4 针对 Claude Code、OpenClaw、OpenCode、CodeBuddy 等主流 Agent 产品做了专项适配和优化,在代码任务、文档生成等实际场景中表现均有提升。模型的价值最终要在真实的开发和工作流程里被检验。

02

继续开源,API 全量开放

DeepSeek 延续了开源路线,并直接全量开放 API 调用。

目前,DeepSeek-V4 的模型权重已同步在 Hugging Face、ModelScope 平台开放下载,配套的技术报告也一并公开,支持开发者进行本地部署与二次开发。

与部分厂商「开源阉割版、闭源完整版」的行业惯例不同,本次开源的两个版本,完整保留了与官方云端 API 一致的全量能力——包括非思考 / 思考双模式、1M 超长上下文无损处理、Agent 专项优化与全量工具调用能力,无任何功能阉割。

这意味着,无论是中小创业公司、个人开发者,还是科研机构,都能零门槛获取到百万上下文、顶级推理与 Agent 能力的大模型底座,无需再为高端模型能力支付高额的闭源接口费用。

为了进一步降低落地门槛,DeepSeek 同步开源了模型微调、量化、推理加速的全流程工具链,完成了 vLLM、TGI 等主流推理框架,以及 LangChain、LlamaIndex 等主流 Agent 框架的 Day 0 原生适配,同时开放了国产算力平台的全栈部署方案,让开发者在不同硬件环境下都能快速落地应用。

与此同时,DeepSeek 也给出了清晰的模型迭代过渡方案:旧有的 API 接口模型名 deepseek-chat 与 deepseek-reasoner,将于三个月后(2026 年 7 月 24 日)停止使用,当前阶段,这两个模型名分别指向 deepseek-v4-flash 的非思考模式与思考模式,给开发者留出了充足的平滑迁移时间。

03

坚定做 AI「基建模型」

把这两天的发布连起来看,一个趋势很明确:各家都在加速 Agent 能力。

过去两年,公众和资本市场对大模型的关注,很大程度上集中在「聪明程度」,但现在已经转向了「谁更能稳定地把事情做完」。GPT-5.5 的发布重点不在于多模态理解又提升了多少,而是它在 Agent 编程、计算机使用、知识工作等场景中的持续执行能力。腾讯混元 Hy3 的核心卖点也在于它在现实世界中的「行动能力」。DeepSeek V4 则直接把 Agent 能力和长上下文处理作为主打,目标明确地指向实际工作负载。

这种转变的背后,是整个行业正在走向「模型效用」的竞争。现在,用户和企业客户越来越不关心你的模型在某项评测里排第几,他们关心的是模型及产品到底能帮自己干好多少活儿:这个模型能不能帮我写代码、能不能处理复杂文档、能不能在多步骤任务里不出错、能不能以合理的成本跑起来。

图片来源:DeepSeek 官网

在今天发布的文末,DeepSeek 引用了《荀子》里的一句话:「不诱于誉,不恐于诽,率道而行,端然正己」,继续锚定了自己的技术路线。放在当下的大模型竞争语境下,这句话的意味很明确——不被外界的评价和噪音干扰,专注于把事情做对。

DeepSeek 过去一年多的行动,确实在践行这个逻辑:用开源开放建立全球开发者生态影响力,用极致的性价比打破高端 AI 能力的使用壁垒,用扎实的底层架构创新解决开发者与企业用户最真实的痛点。

从 R1 推理模型的横空出世,到 V4 把长上下文能力第一次推向普惠区间,DeepSeek 一直在用一种相对「慢」的方式,做一件更难的事——把顶级模型能力,从少数人的工具,变成更多人可以直接调用的基础设施。